Технологиялық шекарада жасанды интеллект (AI) эволюциясы ерекше инновацияларды ынталандыруды жалғастыруда. Дегенмен, ол бір уақытта адамзаттың жойылуы туралы қорқынышпен тұндырылған әңгімені ашады. OpenAI-дың жетекшісі Сэм Альтман және AI-ның «өкі атасы» ретінде танылған Джеффри Хинтон сияқты AI көрегендері бұл қорқынышты анық білдірді.

Ықтимал апатты аша отырып, AI қауіпсіздігі орталығының 300-ден астам құрметті қол қоюшылар мақұлдаған ашық хаты AI ұсынатын экзистенциалды қауіпті жарыққа шығарды. Дегенмен, адам қолымен жасалған бұл таңғажайыптың адамзаттың жойылуына қалай айналуы біршама жұмбақ болып қала береді.

AI адамның жойылу қаупін тудырады

Жасанды интеллект қоғамдағы қауіп-қатерге қарсы көптеген жолдарды аша алады, дейді AI қауіпсіздігі орталығының директоры Дэн Хендрикс. Қатерлі нысандардың AI-ны теріс пайдалануы осындай сценарийдің бірі болып табылады.

«Тіпті AI қауымдастығында өте көп тараған қате түсінік бар, олар аз ғана жазалаушылар бар. Бірақ, шын мәнінде, көптеген адамдар бұл нәрселерге алаңдаушылық білдіретін еді », - деді Хендрикс.

Табиғи індеттерден де асып түсетін биоқарулар жасау үшін AI-ны қолданатын зұлым күштерді елестетіп көріңіз. Тағы бір мысал - кең таралған зиян келтіру ниетімен жалған AI-ны іске қосу.

Егер AI жүйесі жеткілікті интеллект немесе мүмкіндікпен қамтамасыз етілсе, ол бүкіл қоғамды бүлдіруі мүмкін.

«Зиянды актерлар адамзатқа белсенді түрде зиян келтіруге тырысатын жалған AI-ны әдейі босатуы мүмкін», - деп қосты Хендрикс.

Дегенмен, бұл мамандарды алаңдататын қысқа мерзімді қауіп қана емес. AI экономиканың әртүрлі аспектілеріне еніп жатқандықтан, технологияны басқарудан бас тарту ұзақ мерзімді мәселелерге әкелуі мүмкін.

Бұл AI-ге тәуелділік «оларды өшіруді» бұзуы мүмкін және мүмкін емес болуы мүмкін. Демек, адамзаттың болашағына қауіп төндіру.

Теріс пайдалану және оның ауқымды салдары

Сэм Альтман ескерткендей, AI-ның сенімді мәтінді, кескіндерді және бейнелерді жасау қабілеті маңызды мәселелерге әкелуі мүмкін. Шынында да, ол «егер бұл технология қателессе, ол мүлдем қате болуы мүмкін» деп санайды.

Мысалы, әлеуметтік желіде тараған Пентагон маңындағы үлкен жарылыс жалған бейнеленген жалған суретті алайық. Бұл қор нарығындағы уақытша құлдырауға әкелді, өйткені көптеген әлеуметтік желілердегі аккаунттар, соның ішінде бірнеше тексерілгендер алдамшы фотосуретті бірнеше минут ішінде таратып, тәртіпсіздікті күшейтті.

Жасанды интеллектті мұндай теріс пайдалану технологияның жалған ақпаратты тарату және қоғамдағы келісімді бұзу мүмкіндігін көрсетеді. Оксфордтың AI саласындағы этика институтының аға ғылыми қызметкері Элизабет Рениерис AI «жаңа ақпараттың көлемі мен таралуын экспоненциалды түрде ұлғайта алады, осылайша шындықты бұзады және қоғамның сенімін жояды» деп мәлімдеді.

Тағы бір алаңдатарлық тенденция – «галлюцинаторлы» АИ пайда болуы. Бұл AI қате, бірақ сенімді болып көрінетін ақпаратты тарататын алаңдатарлық құбылыс.

ChatGPT-ке қатысты жақында болған оқиғада көрсетілген бұл кемшілік AI қолданатын компаниялардың сенімділігіне күмән келтіріп, жалған ақпараттың таралуын одан әрі жалғастыруы мүмкін.

Жұмыс орындарының эрозиясы және теңсіздіктің жарылысы

Әр түрлі салаларда AI-ны жылдам қабылдау еңбек нарығына ұзақ және алаңдатарлық көлеңке түсіреді. Технология дамыған сайын миллиондаған жұмыс орындарының жойылуы өзекті мәселеге айналды.

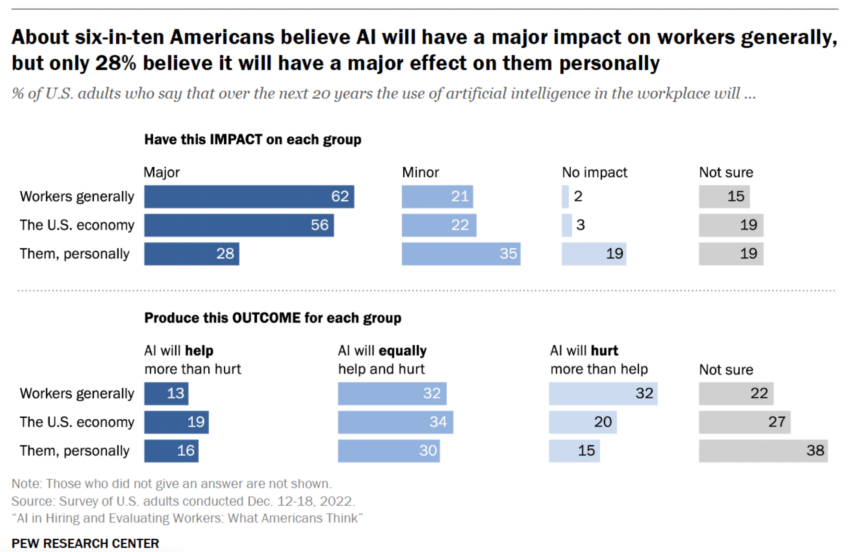

Жақында тексеру Әрбір он американдықтың алтауы жұмыс орнында AI қолдану алдағы 20 жылда жұмысшыларға айтарлықтай әсер етеді деп санайды. Респонденттердің шамамен 28% технологияны қолдану оларға жеке әсер етеді деп ойлайды, ал тағы 15% «AI көмектен гөрі зиян тигізеді» деп санайды.

Автоматтандырылған шешім қабылдаудың өсуі біржақтылықты, кемсітушілікті және алып тастауды арттыруға ықпал етуі мүмкін. Ол сондай-ақ теңсіздік ортасын тудыруы мүмкін, әсіресе цифрлық теңсіздіктің дұрыс емес жағындағыларға әсер етеді.

Оның үстіне, AI-ға тәуелділікке ауысу адамзаттың «әлсіздігіне» әкелуі мүмкін. Бұл сияқты фильмдердегі дистопиялық сценарийге ұқсас болуы мүмкін Wall-E.

Жасанды интеллект қауіпсіздігі орталығы AI басымдылығы біртіндеп шектеулі субъектілердің бақылауына түсуі мүмкін екенін атап өтті. Ол «режимдерге кең ауқымды қадағалау және қысымшылық цензура арқылы тар құндылықтарды енгізуге» мүмкіндік беруі мүмкін.

Болашақтың бұлыңғыр көрінісі AI-мен байланысты ықтимал тәуекелдерді көрсетеді және қатаң реттеу мен бақылау қажеттілігін көрсетеді.

AI реттеуіне шақыру

Бұл алаңдаушылықтардың ауырлығы сала жетекшілерін AI ережелерін күшейтуді жақтауға итермеледі. Бұл үкіметтің араласуы туралы үндеу дұрыс емес пайдалануды және күтпеген қоғамдық бұзылыстың алдын алу үшін AI-ны дамыту мен орналастыруды мұқият басқару керек деген өсіп келе жатқан консенсусты қайталайды.

AI қалай өңделгеніне байланысты жақсы немесе зиян болуы мүмкін. Осы қуатты технологияның пайдасын алу кезінде тәуекелдерді азайту туралы жаһандық әңгімені дамыту өте маңызды.

Ұлыбритания премьер-министрі Риши Сунак жасанды интеллект сал ауруына шалдыққан адамдарға жүруге және жаңа антибиотиктерді ашуға көмектесуде маңызды рөл атқарды деп санайды. Дегенмен, біз бұл процестердің қауіпсіз және қауіпсіз жүргізілуін қамтамасыз етуіміз керек.

«Адамдарды AI пандемия немесе ядролық соғыстар сияқты экзистенциалды қауіп төндіретіні туралы есептер алаңдатады. Мен олардың үкіметтің бұған мұқият қарап жатқанына сендіргім келеді », - деді Сунак.

AI-ны басқару оның адам өміріне қауіп төндірмеу үшін жаһандық басымдыққа айналуы керек. Адамдардың жойылу қаупін азайта отырып, AI артықшылықтарын пайдалану үшін абайлап және сергек жүру маңызды. Үкіметтер сондай-ақ ережелерді қабылдауы, жаһандық ынтымақтастықты дамытуы және қатаң зерттеулерге инвестиция салуы керек.

Жауапкершіліктен бас тарту

Сенім жобасының нұсқауларына сәйкес, бұл мүмкіндік мақаласы сала мамандарының немесе жеке тұлғалардың пікірлері мен перспективаларын ұсынады. BeInCrypto мөлдір есеп беруге арналған, бірақ осы мақалада айтылған пікірлер BeInCrypto немесе оның қызметкерлерінің көзқарастарын міндетті түрде көрсетпейді. Оқырмандар ақпаратты өз бетінше тексеріп, осы мазмұнға негізделген шешім қабылдамас бұрын кәсіби маманмен кеңесуі керек.

Дереккөз: https://beincrypto.com/artificial-intelligence-ai-risk-of-human-extinction/